- Как анализ больших массивов данных меняет лицо журналистики: практический опыт и секреты Data Journalism

- Что такое анализ больших массивов данных и зачем он нужен журналистам?

- Технологии и инструменты анализа больших данных

- Практический опыт: как мы использовали анализ данных в своих расследованиях

- Этапы анализа больших данных в журналистике

- Ошибки и вызовы в работе с большими данными

- Что нужно для успешного анализа больших данных?

- Подробнее

Как анализ больших массивов данных меняет лицо журналистики: практический опыт и секреты Data Journalism

В современном мире информация становится основным ресурсом, а объем данных растет с невероятной скоростью. Журналисты, медиа-компании и аналитики теперь имеют возможность исследовать громадные массивы информации, выявляя тенденции, создавая инсайты и рассказывая истории, которые раньше казались невозможными. Именно этот инструмент — Data Journalism, или журналистика на основе анализа данных — трансформирует традиционные подходы к новостям, делая их более глубокими, точными и придатными к высоким стандартам объективности.

Несмотря на то, что технологии для обработки больших данных развивались в области информационных технологий и аналитики, сейчас эти инструменты успешно применяются и в журналистике. Объединение опыта аналитиков и журналистов позволяет создавать уникальный контент, основанный на фактах, статистике и аналитике. Нам важно понять, как это работает на практике, каким образом можно использовать инструменты анализа больших данных и какие вызовы стоят перед журналистами в этой области. В нашей статье мы расскажем о личном опыте и практических секретах, которые помогут вам стать профессионалом в Data Journalism.

Что такое анализ больших массивов данных и зачем он нужен журналистам?

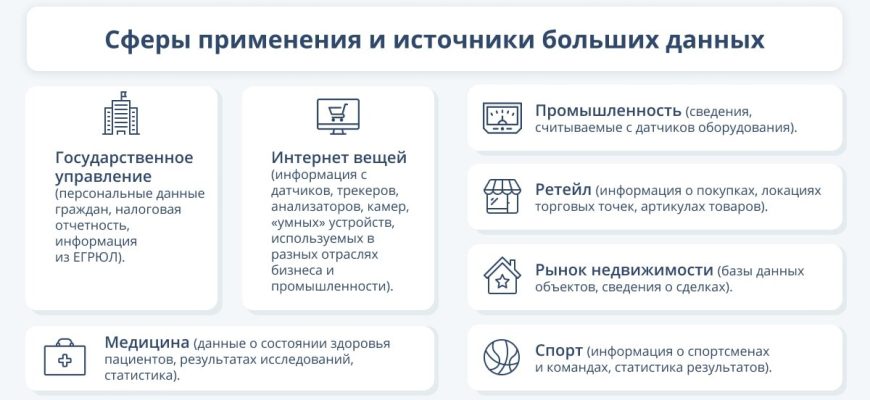

Анализ больших массивов данных — это процесс сбора, обработки и интерпретации огромных объемов информации с целью выявления закономерностей, тенденций и аномалий. Для журналистов это стало мощным инструментом, позволяющим получать факты, которые сложно обнаружить при классическом наблюдении или интервью. Например, анализ государственных данных, финансовых отчетов, публичных реестров или социальных сетей может помочь раскрыть коррупционные схемы, выявить социальные проблемы или проследить тренды в экономике.

Вопрос: Почему аналитика больших данных так важна для современного журналиста?

Ответ: В современном мире объем информации растет в геометрической прогрессии, и традиционные методы сбора новостей иногда просто не позволяют опереться на объективные факты без дополнительных инструментов. Аналитика больших данных помогает минимизировать субъективизм, обнаруживать скрытые связи и предоставлять аудитории более достоверную и обоснованную информацию. Это расширяет горизонты журналистики, делает ее более точной, объективной и актуальной.

Технологии и инструменты анализа больших данных

Работа с большими объемами данных невозможна без специальных программных решений и инструментов анализа. Ниже представлены основные из них, которые используют современные журналисты и аналитики:

- Excel и Google Sheets: начальный уровень, таблицы для предварительной обработки, визуализации и анализа.

- Tableau: для визуализации данных, построения интерактивных графиков и отчетов.

- Python и R: мощные языки программирования для автоматизации обработки, создания алгоритмов анализа и машинного обучения.

- SQL: для работы с базами данных, выборки и обработки структурированных данных.

- Big Data платформы: Apache Hadoop, Spark — для работы с очень большими данными в распределенных средах.

Использование этих инструментов позволяет не только систематизировать информацию, но и находить закономерности, которые были скрыты при поверхностном анализе. На практике это означает, что журналисты могут создавать материал на основе точных данных, без субъективных интерпретаций или предположений.

Практический опыт: как мы использовали анализ данных в своих расследованиях

Наш общий опыт показывает, что применение анализа больших данных открывает новые горизонты для журналистики. В одном из наших последних проектов мы решили раскрыть проблему коррупции в государственных закупках. После сбора базы данных о миллионов контрактов, опубликованных на портале государственных закупок, мы использовали SQL для выборки данных по определенным регионам и компаниям. Далее применили Python для анализа паттернов, выявляющих подозрительные связи и закономерности, ранее скрытые для глаз.

Результатом стал интригующий материал, подкрепленный конкретной статистикой и графиками. Мы не просто рассказали историю, а показали конкретные факты и связи, способные убедить даже скептически настроенного читателя. Этот опыт показал, что работа с большими данными превращается в инструмент не только для расследований, но и для повышения прозрачности всего общества.

Этапы анализа больших данных в журналистике

- Определение темы и формулировка гипотезы: что именно вы хотите узнать или доказать.

- Сбор данных: поиск открытых источников, создание базы данных, автоматизация сбора.

- Обработка данных: очистка, структурирование, подготовка к анализу.

- Анализ: применение методов статистики, визуализация, выявление закономерностей.

- Интерпретация: формировка выводов, подготовка материала.

- Публикация и распространение: создание аналитических статей, инфографики, видеоматериалов.

| Этап | Что делаем | Инструменты |

|---|---|---|

| Определение темы | Формулируем гипотезу и собираем первоначальную информацию | Мозговой штурм, аналитика данных, соцсети |

| Сбор данных | Используем API, скачивание баз, парсинг сайтов | Python, SQL, веб-скрапинг |

| Обработка и анализ | Очистка данных, построение графиков и моделей | Python, R, Tableau |

| Интерпретация результатов | Обоснование выводов, написание публикации | Текст, инфографика, видео |

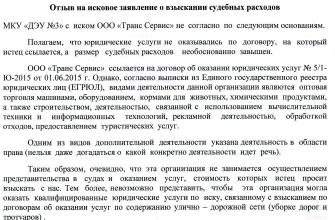

Ошибки и вызовы в работе с большими данными

Несмотря на огромное преимущество в знаниях и возможностях, работа с большими данными сопряжена с рядом сложностей. Главные из них — это качество и достоверность данных, их структурированность и масштабируемость. Бывали случаи, когда собранная информация оказывалась неполной или содержала ошибки, что приводило к искаженному анализу и ложным выводам. Также важной проблемой является необходимость владения навыками программирования и анализа данных, что часто требует времени и обучения.

Еще одним вызовом является этичность: как правильно использовать полученные данные, чтобы не нарушить приватность и не навредить участникам исследования? Важно строго соблюдать нормы приватности и избегать распространения информации, которая может навредить или повредить репутации.

Что нужно для успешного анализа больших данных?

- Наличие четко поставленной гипотезы или вопроса.

- Доступ к качественным и актуальным данным.

- Обучение необходимым инструментам и навыкам анализа.

- Критическое мышление и умение интерпретировать результаты.

- Этическое сознание работы с информацией.

Если только начать использовать анализ данных в журналистике, то потратьте время на освоение базовых инструментов, учитесь критически оценивать источник и качество данных, и всегда старайтесь делать выводы, подкрепленные фактами.

Подробнее

10 LSI-запросов по анализу больших данных в журналистике

| анализ данных для журналистов | инструменты анализа больших данных | Data Journalism примеры | как анализировать большие данные | использование Python в журналистике |

| визуализация данных для журналистов | примеры расследований на базе данных | работа с большими объемами информации | проблемы анализа больших данных | как собрать базу данных журналисту |

| машинное обучение в журналистике | статистика в журналистике | расследования на основе данных | Лучшая литература по Data Journalism | примеры визуализации данных |